卷积神经网络常见的层结构有哪些?

1、卷积层.

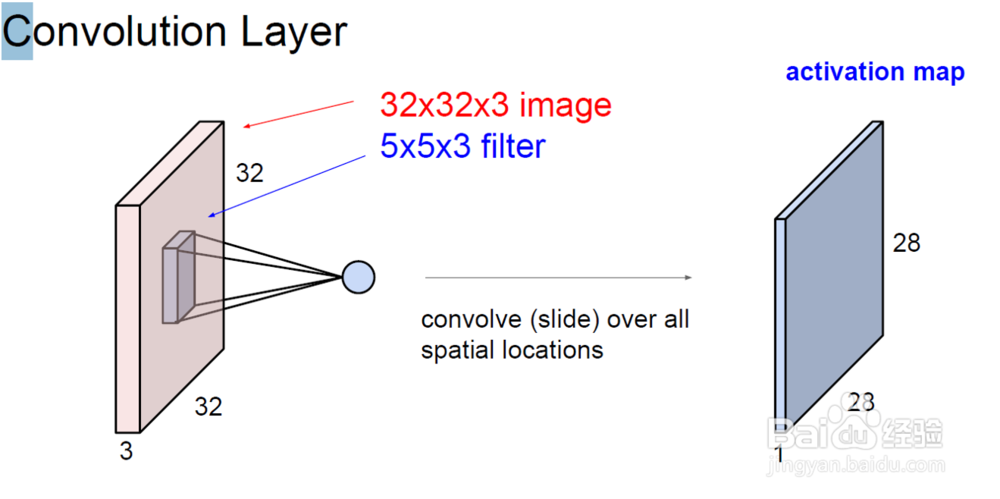

卷积层由参数可学习的卷积核组成。卷积核的宽度和长度可改变,深度必须与输入层的通道数一致。

比如说输入32*32*3的图片,一个卷积核的大小为5*5*3,一个卷积核在padding=0情况下划窗生成一个二维的激活图(28*28*1)。

2、如果我们有6个5*5*3的卷积核,就可以生成28*28*6的激活图。输出层的通道数与卷积核个数一致。

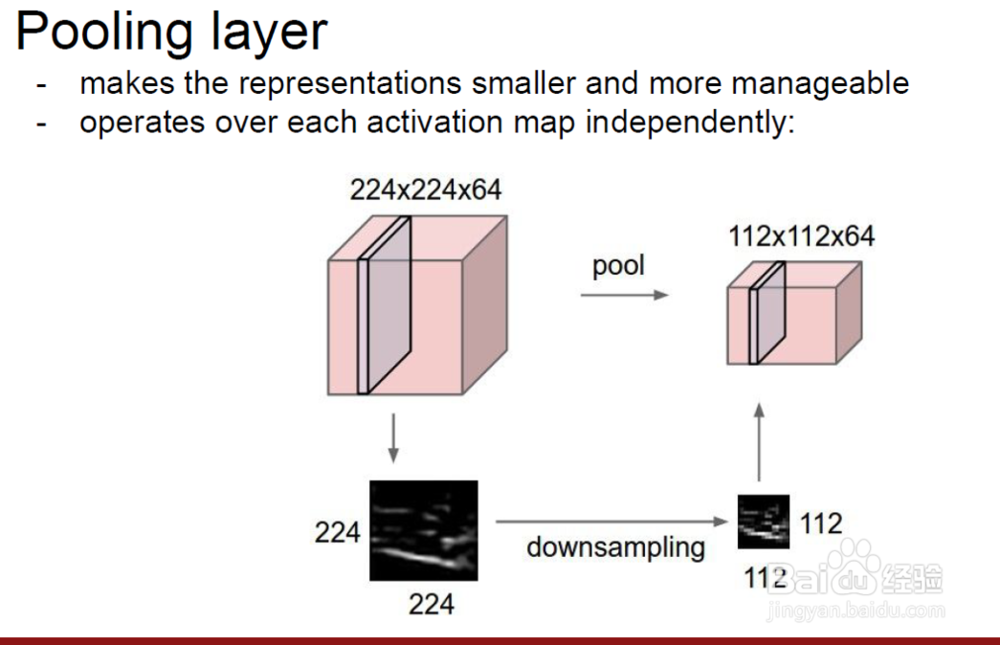

3、池化层:

池化层用来控制图片的空间尺寸,相当于一个降采样的过程。同时,池化层也有着控制过拟合的作用。有maxpooling,averagepooling等类型

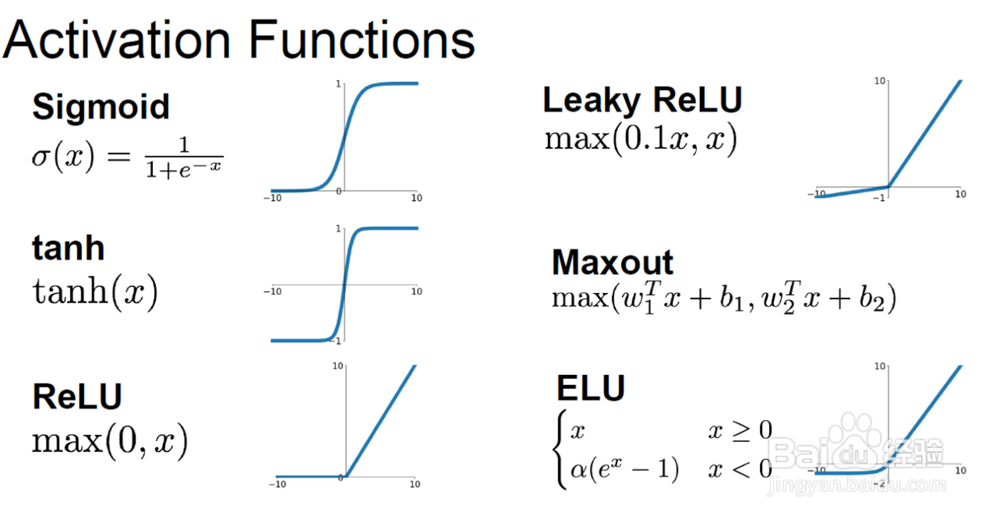

4、激活函数层:

常用的激活函数有sigmoid,ReLU,tanh,leakyReLU等等

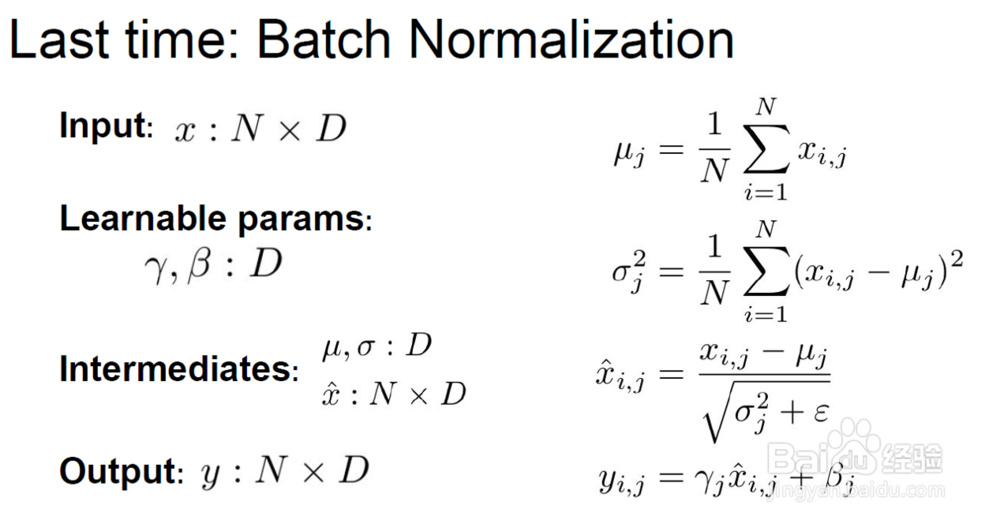

5、归一化层:

最常用的归一化层是Batch Normalization。能使训练速度大大加快。

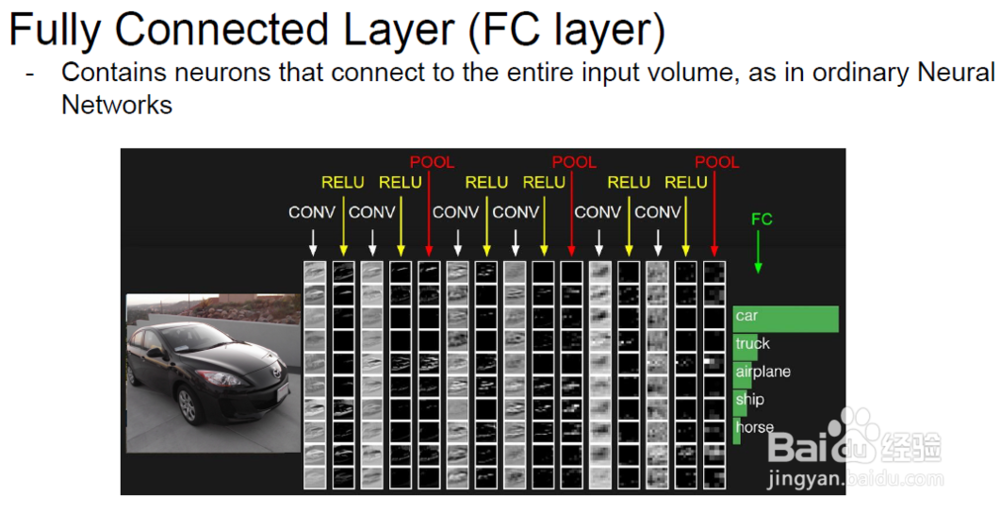

6、全连接层:

全连接层(fully connected layers,FC)指的是神经元完全与输入的变量连接,在整个卷积神经网络中起到“分类器”的作用。

声明:本网站引用、摘录或转载内容仅供网站访问者交流或参考,不代表本站立场,如存在版权或非法内容,请联系站长删除,联系邮箱:site.kefu@qq.com。

阅读量:81

阅读量:157

阅读量:25

阅读量:87

阅读量:49